GPT-3 för dummies. Hur det mest avancerade neurala nätverket i världen fungerar.

Om du inte har uppmärksammat de fantastiska sakerna AI kan göra, är det nu dags att göra det.

Användare på nätet blir galna efter det interaktiva verktyget GPT-3. Dess teoretiska möjligheter och sätt att använda den är fantastiska och otroligt mångsidiga. (G)enerativ (P)omtränad (M)odel 3 är den tredje generationen av OpenAI:s naturliga språkbehandlingsalgoritm. Han kommer att bli din riktiga vän och hjälpare, för han kommer att bete sig precis som du säger till honom.

Om du vill se in i framtiden, ta en titt på hur utvecklare redan använder GPT-3. Utan tvekan, det ska sägas, är vår värld full av exempel på användning av AI, från specialerbjudanden för köp på Amazon till självkörande bilar. AI lyckades lägga sin hand överallt. Dessutom finns det en god chans att det var AI som inspirerade dig att läsa den här artikeln, och andra tekniker var involverade i att skriva den.

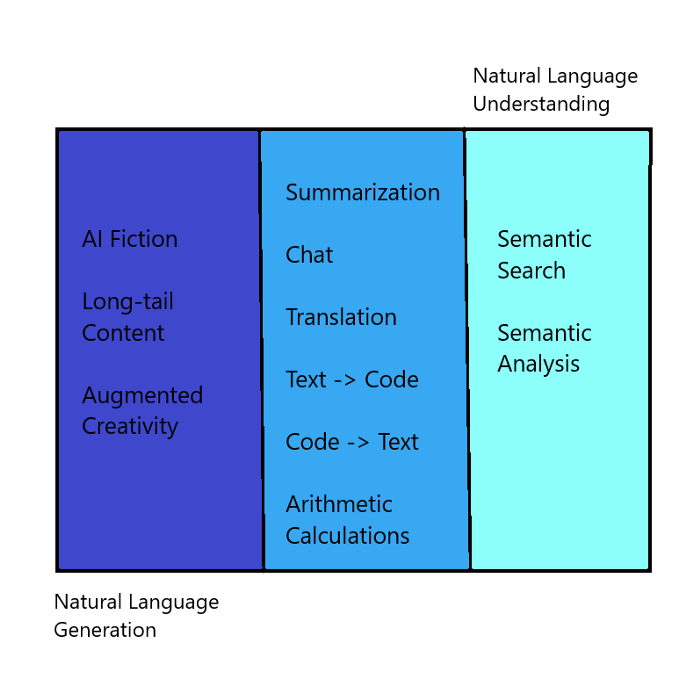

GPT-3 är en speciell algoritm som kan utföra olika mänskliga talbearbetningsuppgifter. Han kan agera författare, journalist, poet, författare, forskare eller bot. GPT-3 betraktas också av forskare som en algoritm med vilken vi kan ta det första steget mot att skapa artificiell allmän intelligens (AGI). AGI är maskiners förmåga att lära sig och utföra uppgifter som liknar dem som utförs av människor.

Det fanns en tid då denna algoritm var ett riktigt mysterium för forskare. Men i takt med att tekniken har utvecklats har den blivit mer och mer tillgänglig för både professionella och vanliga användare. För att förstå grunderna i hur GPT-3 fungerar måste vi bekanta oss med principerna för maskininlärning, som är nyckeln till hur denna unika algoritm fungerar. Maskininlärning är en integrerad del av artificiell intelligens. Det gör att maskinen kan förbättra sig själv med den erfarenhet som vunnits.

Det finns två typer av maskininlärningsalgoritmer: övervakade och oövervakade.

Övervakat lärande inkluderar algoritmer som behöver märkta data. Med andra ord, låt oss säga att din bil är 5 år gammal. Du vill lära henne att läsa och sedan kontrollera om färdigheten har lärt sig. Vid övervakad inlärning tillhandahåller vi märkta data till maskinen. Efter det kollar vi om hon kunde lära sig något eller inte.

Människor får naturligtvis färdigheter under övervakat lärande. Men det mesta av sin tid lär de sig genom att analysera sina erfarenheter och försöka förutsäga framtiden med sin intuition. Detta är precis principerna för oövervakat lärande.

Supervised VS Unsupervised Learning

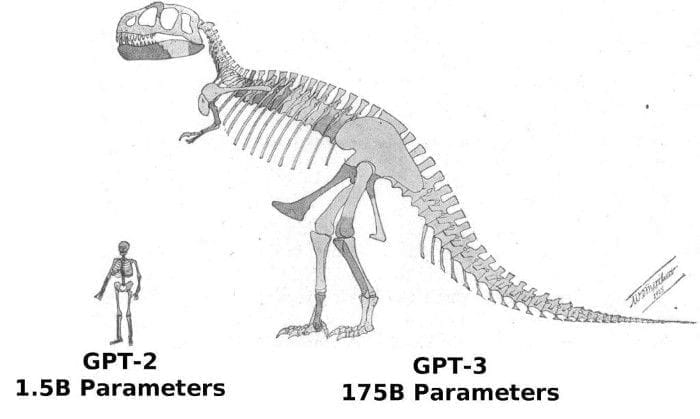

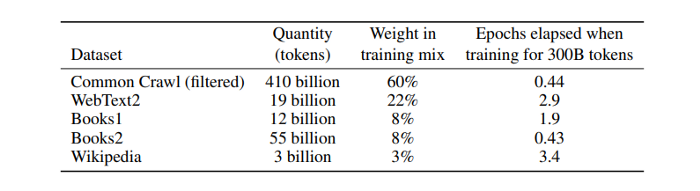

GPT-3 använder oövervakad inlärning. Det är kapabelt till meta-lärande, det vill säga lära sig utan träning. GPT-3-utbildningskorpusen består av en datauppsättning för gemensam genomsökning. Den innehåller 45 TB textdata som erhållits från Internet. GPT-3 har 175 miljarder modellparametrar, medan den mänskliga hjärnan har 10-100 biljoner.

För att förstå principerna för livet på jorden, universums skala och andra mänskliga subtiliteter är det nödvändigt att ha 4 398 biljoner modellparametrar. Den takt som GPT växer med är skrämmande – den ökar med cirka 100 gånger varje år, vilket är både överraskande och oroande.

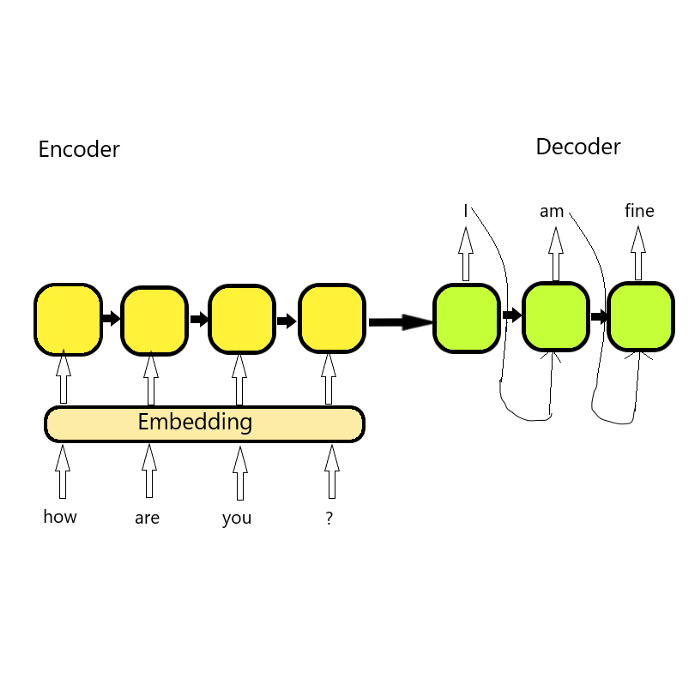

Vi vet att maskininlärningsmodeller alltid fungerar med hög noggrannhet. Men analysen av mänskligt språk är deras svaga punkt. För att övervinna denna brist konverterar vi text till siffror med hjälp av inbäddning och skickar dem till våra maskiner. Maskiner använder kodare och avkodare för att hjälpa dem att känna igen meddelandet.

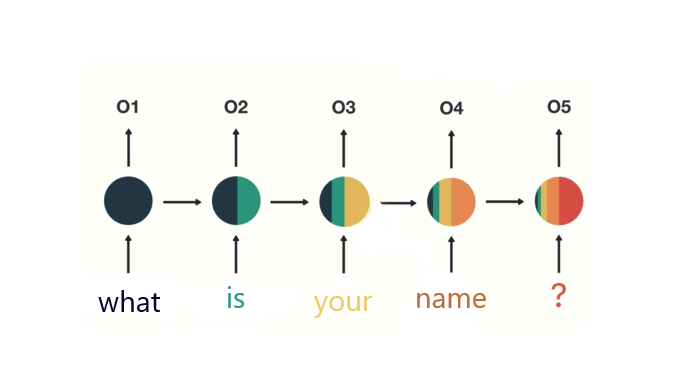

Återkommande neurala nätverk (RNN) är en klass av neurala nätverk som är bra för att modellera sekventiell data som tidsserier eller naturligt språk. Men på grund av den enorma mängden textinformation kan vi inte vara säkra på att meddelandet kommer att läsas på ett grundligt sätt. För bättre igenkänning av det skickade meddelandet använder vi uppmärksamhetsmekanismen. Det fungerar på exakt samma sätt som vår hjärna. När vi sparar viss information i den filtrerar den bort den viktiga informationen och tar bort de onödiga. Uppmärksamhetsmekanismen hjälper till att hålla räkningen på varje bilaga. Betyget för dataviktighet gör det möjligt att filtrera bort irrelevant information.

Hur RNS fungerar

När vi skickar vår textdata till maskinen går den genom kodaren och vektorer skapas. De resulterande vektorerna analyseras ytterligare av uppmärksamhetsmekanismen. Denna blandade process hjälper till att förutsäga nästa ord en person kommer att säga. Enkelt uttryckt, det finns " fylla i luckorna " baserat på hur säker maskinen är i sin kunskap. När den får språk kan maskinen bättre förutsäga nästa ord. Med stor erfarenhet kommer hon att exakt förutsäga möjliga alternativ. Därefter skickar vi det mottagna ordet med den tillgängliga förutsägelsen till avkodaren. Cykeln med att generera nya förslag fortsätter i det oändliga, vilket hjälper till att förbättra AGI.

Den främsta höjdpunkten med GPT-3 är dess enorma datakorpus och oändliga inlärningsmöjligheter. Inlärningen i sig är inte domänspecifik, men låter algoritmen lära sig hur man utför vilken domänspecifik uppgift som helst. Be algoritmen att skriva en SQL-fråga och det kommer att göra susen. Be honom hjälpa till att skriva en text om ett sportämne – det kan han också göra.

Källa: GPT-3 Paper

GPT-3 fungerar bättre med flera träningsramar: när du ger den en ledtråd och några exempel. Föreställ dig att du gav ett par böcker till en nybörjare och bad henne svara på frågor. Ibland lyckades hon, och ibland misslyckades hon. Så du fortsätter att ge henne fler böcker och ställa fler frågor, vilket hjälper henne att förbättra sina kunskaper. Det gör hon genom att läsa nytt material och titta på exempel på liknande frågor.

GPT-3 är fortfarande en maskin, den kommer att kunna lära sig av många exempel. När vi lär oss att köra bil väljer vi ett stort antal platser för att finslipa våra kunskaper. Vi börjar med vägar där ett litet antal bilar kör. Sedan går vi till spåren med tätare biltrafik. Och slutligen, efter att ha fått fullständigt självförtroende, kör vi längs den mest trafikerade gatan för att skaffa oss den färdighet vi behöver. Om du kör på vägar med endast måttlig trafik, då kommer du definitivt inte att kunna köra bil under rusningstid. På samma sätt, om vi vill få den bästa modellen, måste vi förse den med olika träningsförhållanden.

GPT-3 lär sig ständigt. Det är den bästa algoritmen inom AI-området. GPT-3 kan dock inte bete sig exakt som vi gör. När allt kommer omkring behöver barn inte se miljontals exempel för att lära sig något nytt. GPT-3 lär sig på Internet och absorberar ibland all negativitet som finns där. Det kan efterlikna naturligt språk, men när det kommer till naturliga tankar kommer AI fortfarande till korta. Det finns en fin linje mellan naturligt språk och naturligt tänkande. GPT-3 visade att skalning av språkmodellen kan förbättra påståendenas noggrannhet. För att använda ett språk som är identiskt med en människa behöver en maskin inte en själ, utan en enorm mängd data.

När jag var barn gav vår lärare oss den första delen av manuset och bad oss skriva en uppföljare. Jag ägnade timmar åt att hitta på vändningar i handlingen och sedan föra dem till min lärare. Varje gång fick jag låga betyg och förstod inte varför.

I många år fortsatte jag med detta och förstod fortfarande inte anledningen. Men en dag gick det upp för mig att jag gjorde allt fel. Jag var för upptagen med att fokusera på mina kreativa tankar, men allt som krävdes för att få ett bra betyg var frånvaron av grammatiska fel. Tydligen lärde han oss att "skriva" och inte "tänka kreativt". Ändå skulle jag vilja erkänna att grammatik inte var min starka sida, till skillnad från att skapa en intressant handling.

Detta är precis vad GPT-3 gör. Han hämtar mycket av sin kunskap från tidigare verk skapade av människor. Och allt han bryr sig om är att skapa liknande mänskliga tankar och ord. Den fokuserar på " stil " snarare än " kreativitet eller förståelse för orsaker ". Grammatik är hans programmeringsspråk.

Det går inte att förneka att han är bra på att förutse möjliga ordval. GPT-3 är dock varken utformad för att lagra fakta eller för att hämta dem vid rätt tidpunkt, som den mänskliga hjärnan gör. Det är mer som en algoritm för att välja nyckelord från en mall, som är fallet med SEO.

En sådan maskin (även efter att ha träffat människor via Internet) saknar mänskliga egenskaper. Det är bara en algoritm och det är orimligt att förvänta sig att den ska kunna " uttrycka " sina privata tankar. Han saknar fortfarande IQ, vilket är det som skiljer människor från maskiner. Jag hoppas att det förblir så (åtminstone ett tag).

Kommer från Mot AI.

Omslagsbild: Kasia Bojanowska