GPT-3 для чайників Як працює найпередовіша нейромережа у світі.

Якщо ви не звертали увагу на те, які чудові речі може творити ІІ, настав час це зробити.

Користувачі в мережі божеволіють за інтерактивним інструментом GPT-3. Його теоретичні можливості та шляхи використання разючі і неймовірно багатогранні. (G)enerative (P)retrained (M)odel 3 – це третє покоління алгоритму обробки природної мови від OpenAI. Він стане вашим справжнім другом і помічником, оскільки поводитиметься саме так, як ви йому скажете.

Якщо ви хочете заглянути в майбутнє, гляньте на те, як розробники вже використовують GPT-3. Безперечно, слід сказати, у нашому світі повно прикладів використання ІІ: починаючи від спецпропозицій для покупки на Amazon і закінчуючи безпілотними автомобілями. ІІ всюди встиг прикласти свою руку. Більше того, є велика ймовірність, що саме ІІ спонукало вас прочитати цю статтю, а інші технології були задіяні для її написання.

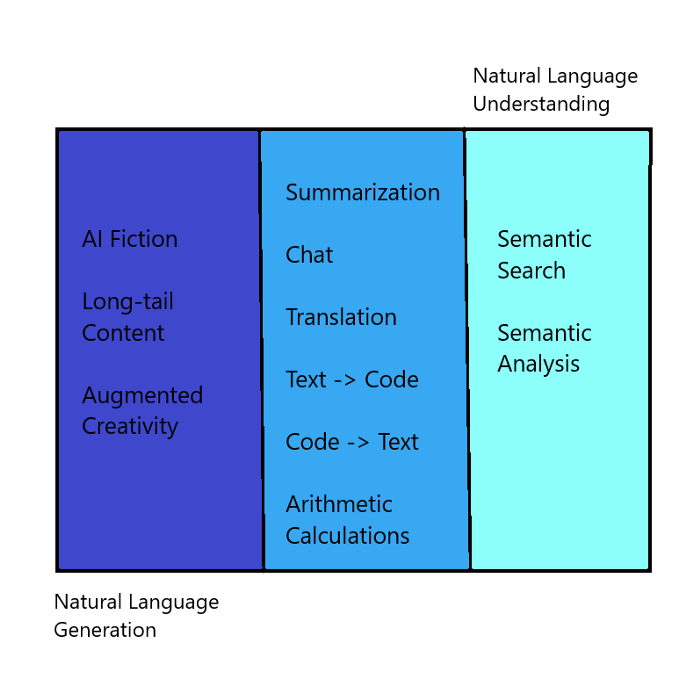

GPT-3 – це спеціальний алгоритм, який може виконувати різні завдання з обробки людської мови. Він може у ролі письменника, журналіста, поета, автора, дослідника чи бота. GPT-3 також розглядається дослідниками як алгоритм, за допомогою якого ми зможемо зробити перший крок до створення Artificial General Intelligence (AGI). AGI – це здатність машин навчатися та виконувати завдання, подібні до тих, які вирішують люди.

Був час, коли цей алгоритм був справжньою загадкою для вчених. Проте з розвитком технологій він ставав дедалі доступнішим як фахівцям, і звичайним користувачам. Щоб зрозуміти основи того, як працює GPT-3, ми повинні ознайомитися з принципами машинного навчання, яке є ключовим моментом у роботі цього унікального алгоритму. Машинне навчання – невід’ємна частина штучного інтелекту. Воно дозволяє машині покращувати себе за допомогою набутого досвіду.

Існує два типи алгоритмів машинного навчання: контрольовані та неконтрольовані.

Контрольоване навчання включає алгоритми, які потребують маркованих даних. Іншими словами, припустимо, що ваша машина – це 5-річна дитина. Ви хочете навчити її читати, а потім перевірити, чи було отримано цю навичку. При контрольованому навчанні ми надаємо машині марковані дані. Після цього ми перевіряємо, чи змогла вона навчитися чогось чи ні.

Люди, звичайно, набувають навичок і під час контрольованого навчання. Проте більшу частину свого часу вони навчаються, аналізуючи свій досвід і намагаючись передбачити майбутнє за допомогою інтуїції. Саме в цьому й полягають принципи неконтрольованого навчання.

Контрольоване VS неконтрольоване навчання

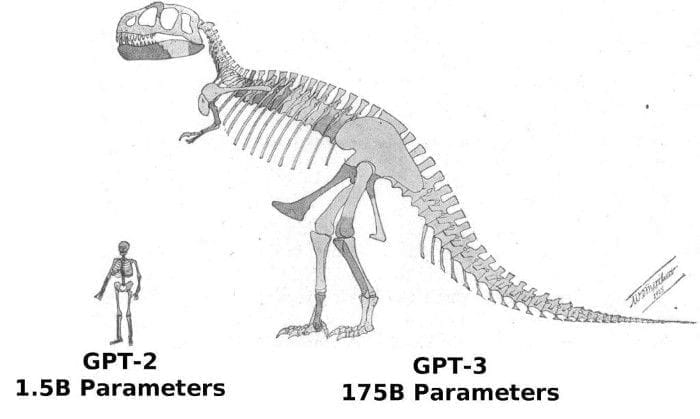

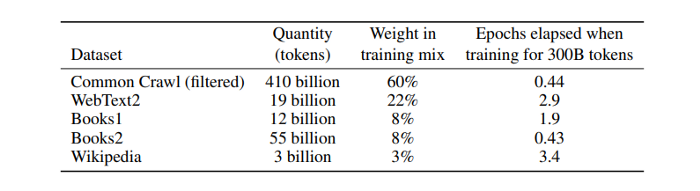

GPT-3 використовує неконтрольоване навчання. Він здатний до мета-навчання, тобто навчання без будь-якої підготовки. Навчальний корпус GPT-3 складається з набору даних типу common-crawl. Він включає 45 ТБ текстових даних, отриманих з Інтернету. GPT-3 має 175 мільярдів параметрів моделей, тоді як людський мозок має 10-100 трильйони.

Щоб зрозуміти принципи життєустрою Землі, масштаби Всесвіту та інші людські тонкощі необхідно мати 4,398 трильйона параметрів моделей. Те, з яким темпом зростає цей показник у GPT, лякає – щороку він збільшується приблизно в 100 разів, що водночас дивовижно і викликає занепокоєння.

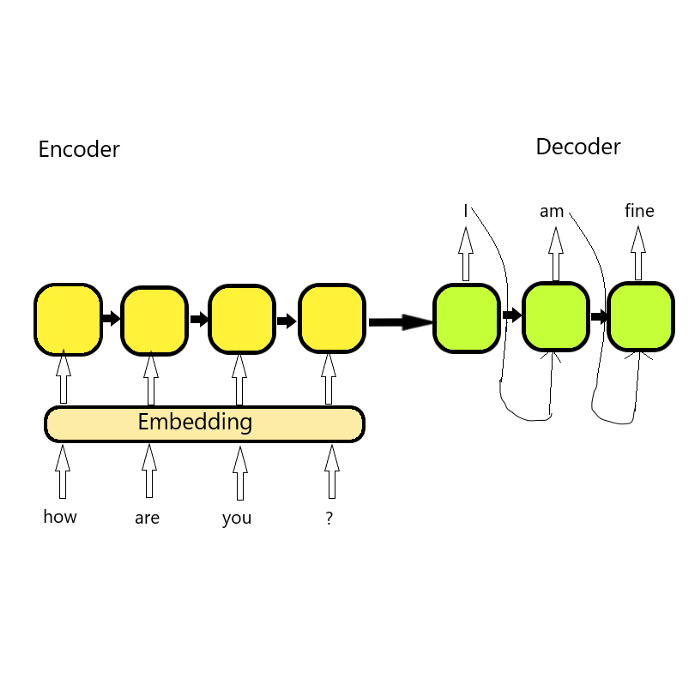

Ми знаємо, що моделі машинного навчання завжди працюють із високою точністю. Проте аналіз людської мови – це їхнє слабке місце. Щоб впоратися з цим недоліком, ми перетворимо текст у числа за допомогою вбудовування та передаємо їх нашим машинам. У машинах використовуються кодери та декодери, які допомагають їм розпізнати повідомлення.

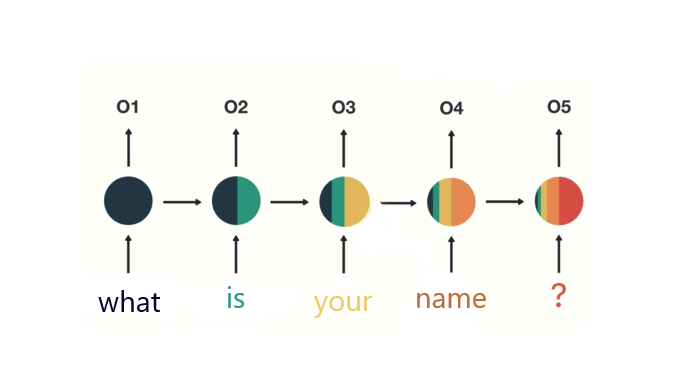

Рекурентні нейронні мережі (РНС) – це клас нейронних мереж, які є хорошими для моделювання послідовних даних, таких як тимчасові ряди або природна мова. Однак через величезний обсяг текстової інформації ми не можемо бути впевнені, що повідомлення буде прочитано досконалим чином. Для кращого розпізнавання надісланого меседжу ми використовуємо механізм уваги. Він працює так само, як і наш мозок. Коли ми зберігаємо певну інформацію, він відфільтровує важливі дані і видаляє непотрібні. Механізм уваги допомагає вести рахунок кожному вкладенню. Оцінка важливості даних дозволяє відфільтровувати нерелевантну інформацію.

Як працюють РНР

Коли ми надсилаємо наші текстові дані машині, вони проходять через кодер, після чого створюються вектори. Отримані вектори аналізуються механізмом уваги. Такий змішаний процес допомагає передбачити таке слово, яке скаже людина. Простіше кажучи, відбувається " заповнення прогалин ", засноване на тому, наскільки машина впевнена у своїх знаннях. У міру того, як вона опановує мову, машина може краще передбачати такі слова. Маючи величезний досвід, вона з точністю прогнозуватиме можливі варіанти. Далі, ми відправляємо отримане слово з передбаченням в декодер. Цикл генерування нових пропозицій продовжується нескінченно, що допомагає покращувати AGI.

Головною родзинкою GPT-3 є його величезний корпус даних та нескінченні можливості навчання. Саме навчання не є предметно-специфічним, але дозволяє алгоритму навчитися виконувати будь-яке предметно-специфічне завдання. Попросіть алгоритм написати SQL запит, і він впорається. Попросіть його допомогти у написанні тексту на спортивну тематику – він також зможе це зробити.

Джерело: GPT-3 Paper

GPT-3 працює краще з кількома кадрами навчання: коли ви надаєте йому підказку та кілька прикладів. Уявіть, що ви дали пару книг першокурсниці та попросили її відповісти на запитання. Іноді їй це вдавалося, інколи ж вона не справлялася. Тому ви продовжуєте давати їй все більше книг і ставити все більше запитань, що допомагає їй удосконалювати свої знання. Вона робить це, знайомлячись із новим матеріалом та переглядаючи приклади схожих питань.

GPT-3 – це все-таки машина, вона зможе вчитися, беручи за основу безліч прикладів. Коли ми вчимося керувати автомобілем, ми вибираємо величезну кількість місць, щоб відточити свою навичку. Ми починаємо з доріг, якими їздить невелика кількість машин. Потім ми вирушаємо на траси з більш щільним автомобільним рухом. І, нарешті, здобувши повну впевненість у собі, ми їдемо найжвавішою вулицею, щоб придбати необхідну нам навичку. Якщо ви будете їздити дорогами тільки із середньою завантаженістю, то ви точно не зможете водити машину в годину-пік. Так само, якщо ми хочемо отримати найкращу модель, нам потрібно надати їй різні умови для навчання.

GPT-3 навчається постійно. Він є найкращим алгоритмом у сфері ІІ. Однак GPT-3 не може поводитися так само, як ми. Зрештою, дітям не потрібно бачити мільйони прикладів, щоб дізнатися про щось нове. GPT-3 навчається в Інтернеті та іноді поглинає весь негатив, який знаходиться там. Він може імітувати природну мову, але коли справа доходить до природних думок, ІІ все ще зазнає невдачі. Існує тонка грань між природною мовою та природними думками. GPT-3 довів, що масштабування мовної моделі може підвищити точність висловлювань. Щоб використовувати мову, ідентичну людському, машині потрібна не душа, а величезна кількість даних.

Коли я був дитиною, наш учитель давав нам першу частину сценарію та просив написати продовження. Я годинами вигадував повороти сюжету і потім приносив їх своєму викладачеві. Щоразу я отримував низькі оцінки та не розумів за що.

Протягом багатьох років я продовжував це робити і все ще не розумів причини. Однак одного разу до мене дійшло, що я роблю все неправильно. Я був надто зайнятий, зосередившись на своїх творчих думках, але все, що потрібно було, щоб отримати хорошу оцінку, – це відсутність граматичних помилок. Мабуть, він навчав нас «писати», а не «мистецько мислити». Хочеться все-таки зізнатися, що граматика – не була моєю сильною стороною, на відміну від створення цікавого сюжету.

Це те, що робить GPT-3. Він черпає більшу частину своїх знань із попередніх робіт, створених людьми. І все, про що він переживає, – це створення подібних людських думок та слів. Він фокусується на «стилі », а не на «творчості чи розумінні причин ». Граматика – це його мова програмування.

Не можна заперечувати, що він добре передбачає можливі варіанти слів. Однак GPT-3 не призначений ні для зберігання фактів, ні для їхнього вилучення в потрібний час, як це робить людський мозок. Він більше схожий на алгоритм для підбору ключових слів за шаблоном, як у випадку з SEO.

Подібної машини (навіть після знайомства з людьми через Інтернет) не вистачає людських рис. Це лише алгоритм, і нерозумно чекати, що він зможе «висловити» свої особисті думки. Йому все ще не вистачає IQ, який і відрізняє людей від машин. Я сподіваюся, що так буде й надалі (хоча б якийсь час).

За матеріалами Towards AI.

Зображення на обкладинці: Kasia Bojanowska